共7篇关于"训练"的文章

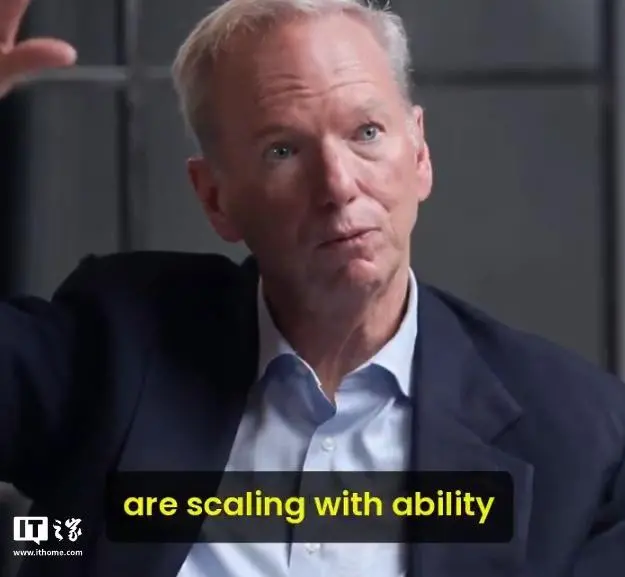

谷歌前CEO:AI性能将继续高速增长,潜在威胁不容忽视

近期有传言称包括 OpenAI、谷歌和 Anthropic 在内的顶级 AI 实验室在开发先进的 AI 模型方面遇到了困难。这些报道将原因归咎于缺乏高质量的训练数据,导致收益递减,进而使得继续投资变得困难。对此,OpenAI CEO Sam Altman 和 Anthropic CEO Dario Amodei 均表达了不同意见。Altman 在社交媒体上发布了一条神秘的信息,暗示“不存在极限”,似乎是对这些负面报道的回应。Amodei 也持类似观点,虽然他承认许多因素可能阻碍 AI 的发展,但他乐观地认为总有方法可以克服这些障碍,包括使用合成数据。IT之家注意到,前谷歌 CEO 埃里克・施密特(Eric Schmidt)也对这些报道发表了自己的看法。他认为,未来五年内,大型语言模型还将经历两到三次的迭代。这些模型的性能正在以史无前例的速度增长,目前还没有证据表明这种增长趋势即将停止。虽然最终会遇到瓶颈,但现在还没到那一步。Schmidt预测未来将出现更加先进和强大的AI模型,在物理学和数学等领域尤为突出。